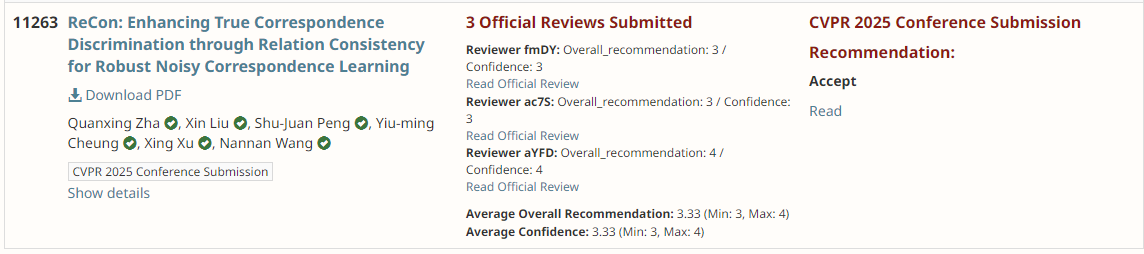

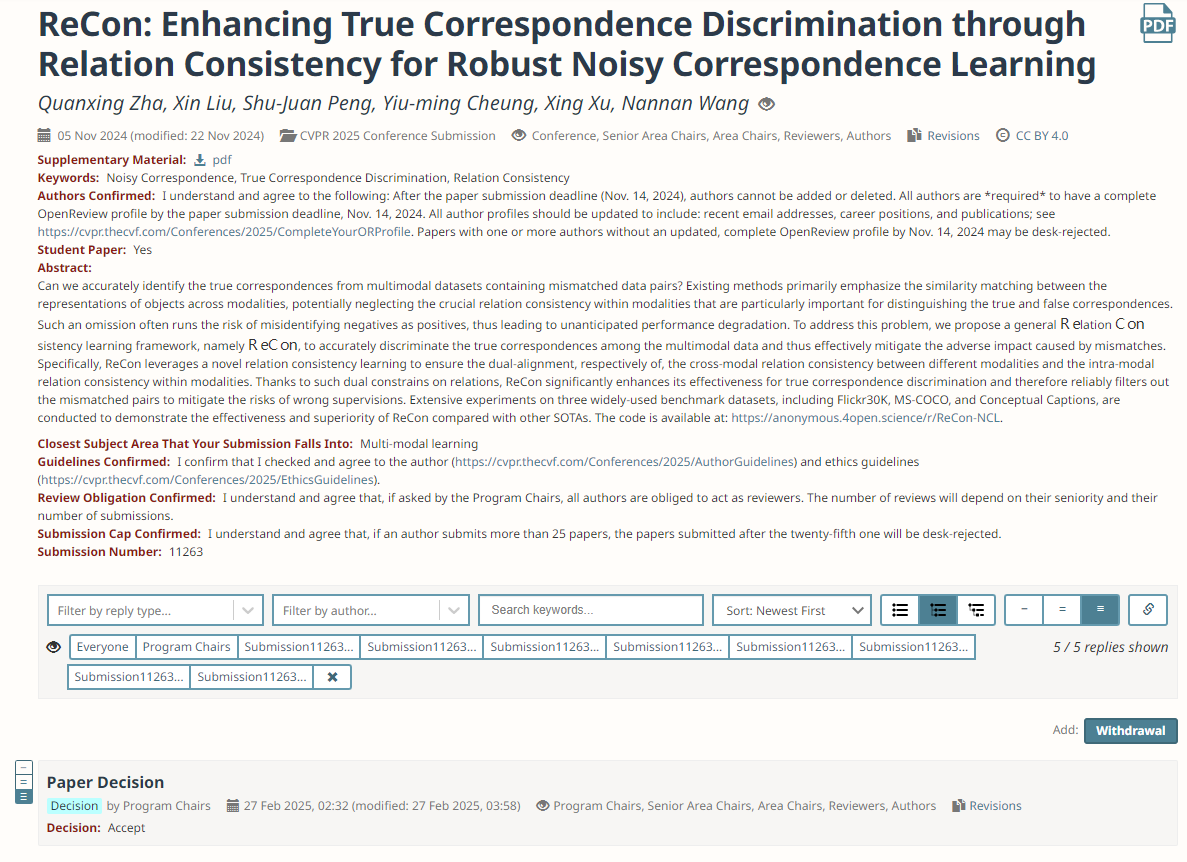

近日,中国计算机学会(CCF))推荐A类国际计算机视觉与模式识别顶级会议(The IEEE/CVF Conference on Computer Vision and Pattern Recognition 2025)公布了录用结果,我院2023级硕士研究生查全兴(导师柳欣教授)关于关系一致性增强的鲁棒噪声关联学习研究成果(题为“ReCon: Enhancing True Correspondence Discrimination through Relation Consistency for Robust Noisy Correspondence Learning”)被录用。CVPR即IEEE国际计算机视觉与模式识别会议,该会议是由IEEE举办的计算机视觉与模式识别领域的顶级会议,CCF推荐A类国际学术会议!根据会议官方统计,本次CVPR 2025会议总投稿13008篇,录用2878篇,录用率仅为22.1%,会议将于2025年6月11日-6月15日在美国田纳西州纳什维尔举办。

在跨模态匹配与视觉表征学习领域,噪声关联问题长期制约模型性能。现有方法通常依赖单一相似度计算判别样本匹配性,然而在复杂实际场景中,大量表面特征相似但语义无关的“高难度噪声样本对”易导致模型误判,严重损害算法鲁棒性。针对这一挑战,该研究创新地提出关系一致性度量框架ReCon,突破传统单维度相似性评估的局限性。通过构建跨模态关系一致性,系统解析样本间的潜在语义关联网络,结合提出的代理关系建模技术,缺乏准确关系数据标注的情况下精准定位高度混淆噪声样本,有效区分“伪相似”。 该研究在三个公开数据集上进行了大量实验,突出了所提出框架的优越性能,并展示了与国内外先进方法相比的竞争性。

该研究工作中,我校为第一完成单位,我院柳欣教授为通讯作者,我院彭淑娟教授,香港浸会大学张晓明讲席教授,电子科技大学徐行教授以及西安电子科技大学王楠楠教授参与了该研究工作。该研究工作得到了福建省大数据智能与安全重点实验室,厦门市计算机视觉与模式识别重点实验室的实验设备支持。

论文录用截图

编辑:彭淑娟

复审:彭佳林

终审:陈荣美